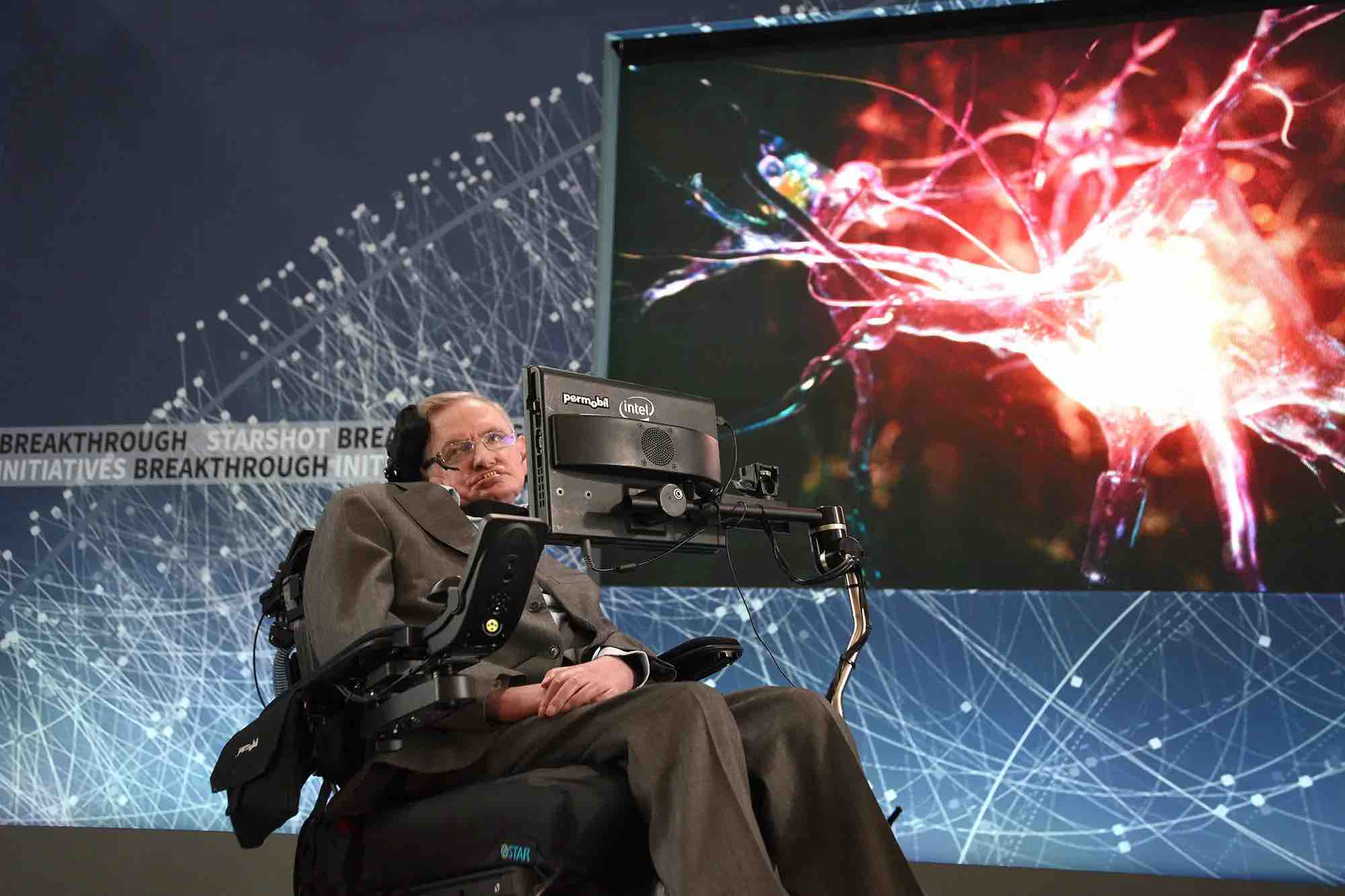

据《纽约邮报》报道,早在特斯拉创始人伊隆·马斯克(Elon Musk)和苹果联合创始人史蒂夫·沃兹尼亚克(Steve Wozniak)签署警告信,指出人工智能对人类构成“深远风险”之前,英国理论物理学家斯蒂芬·霍金(Stephen Hawking)就在 2014 年接受采访时警告称,“全面发展人工智能可能会预示着人类的终结”。

霍金因患有进行性肌萎缩症(ALS)超过 55 年,于 2018 年去世,享年 76 岁。尽管他对人工智发表了批评言论,但由于疾病导致肌肉萎缩,霍金还使用了这项技术,通过捕捉他的面部运动来选择单词或字母,然后将它们合成为语音进行交流。

霍金认为,一些非常基础的人工智能形式已经证明具有强大的能力,但是如果创造出可以与人类智能匹敌或超越人类智能的系统,可能会对人类造成灾难性的后果。他说:“人工智能会自我启动,并以越来越快的速度重新设计自己。”

图源:NY Post

他表示,由于人类的进化速度很慢,而人工智能的发展速度非常快,因此在未来 100 年内,人工智能有可能在智力方面超越人类,使得人类无法与之竞争。这也是他的书中“大问题”之一。他在这《简明回答大问题》(Brief Answers to the Big Questions)本书中回答了许多他经常被问到的问题,包括他对上帝存在的看法、人类未来可能在太空中生活的方式,以及他对基因工程和全球变暖的担忧。

霍金在书中写道:“我们可能会面临智能爆炸,最终导致机器的智能超过我们的智能。”同时,他警告称,不认真对待人工智能带来的风险,可能会成为“我们有史以来犯下的最严重的错误。”

霍金的话与科技巨头们的担忧相呼应。今年三月,数千名科技专家一起签署了一封公开信,呼吁停止开发比 OpenAI 的 GPT-4 聊天机器人更强大的人工智能系统,并至少暂停六个月。

图源:Yahoo

OpenAI 的 ChatGPT 是一个模拟人类对话的聊天机器人,可以根据给定的提示进行人类化的交流。截至 2022 年 1 月,它已成为用户增长最快的软件系统,拥有 1 亿月活跃用户。尽管有呼吁要求暂停研究超越 GPT-4 的 AI 技术,但该系统的发布已产生深远影响,引领各家公司竞相构建自己的 AI 系统。

现如今,发出关于人工智能的警报已成为 ChatGPT 时代的一种流行消遣。被认为是人工智能“教父”的杰弗里·辛顿(Geoffrey Hinton)退出谷歌,并称人工智能聊天机器人的一些危险“相当可怕”。“不良行为者”可能会以对社会产生不利影响的方式使用人工智能,例如操纵选举或煽动暴力等。

不仅如此,世界经济论坛的一份新报告显示,人工智能等技术的发展可能会使近 25% 的工作岗位发生变化。该组织预计在五年内,总体工作岗位将减少 1400 万个。不过,虽然有些工作被淘汰,但有些新工作岗位也会被创造出来。

除了人工智能的影响,新冠大流行的影响、供应短缺和全球成本危机也可能在未来几年导致就业下降。

信息来源:NY Post, CNBC

发表评论 取消回复